1. 软件准备

- python解释器安装【Python3.12.8下载】要求必须3.12

- 安装git 【Git下载】

- conda虚拟环境安装【conda下载】

选择anaconda,开箱即用,安装后即可使用大量数据科学工具- 将

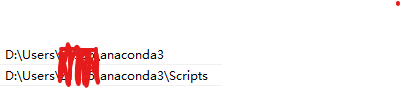

%anaconda安装位置%和%anaconda安装位置% /Scripts加入系统环境变量

- 将

- ollama安装 【Ollama下载】

2.环境准备

- 新建一个文件夹,在此处打开CMD(或者cd到文件夹下),输入命令

conda create -n manus python=3.12

提示Proceed ([y]/n)?

输入y,安装一下 - 激活环境(如果第一次出错,就以管理员身份打开CMD重试)

CMD内输入conda init

继续输入conda activate manus

环境激活成功时,命令行会有一个括号(manus) C:\Windows\system32> - 克隆OpenManus项目

git clone https://github.com/mannaandpoem/OpenManus.git

如果挂了梯子还无法连接,尝试ipconfig /flushdns刷新 DNS 解析缓存 - 进入项目

cd ./cd OpenManus - 安装所需依赖

pip install -r requirements.txt

3.Ollama 本地部署AI

- 开启ollama,拉取支持函数调用的模型

CMD输入ollama pull qwen2.5-coder:14b

模型可以根据自己的配置来选择 【模型列表】,无论选择哪个,一定要支持函数调用,此外还要有一个视觉模型,这里qwen-coder都有 - 修改ollama配置文件

在OpenManus路径下找到.\config\config.example.toml,把config.example.toml改成config.toml,并修改配置内容为:# Global LLM configuration[llm]model = "qwen2.5-coder:14b"base_url = "http://127.0.0.1:11434/v1"api_key = "sk-..."max_tokens = 4096temperature = 0.0# Optional configuration for specific LLM models[llm.vision]model = "qwen2.5-coder:14b"base_url = "http://127.0.0.1:11434/v1"api_key = "sk-..."

如果使用了其他模型请自行修改配置

4.享用OpenManus

配置完成之后,先打开一个CMD输入ollama run qwen2.5-coder:3b运行本地LLM

再开启一个CMD进入conda环境,路径更改到OpenManus的文件夹下,输入python main.py开始体验吧